ب) ادراکات؛ مادّی یا مجرّد؟

اقسام اطّلاعات

اطلاعاتی که هر شخصی در عمر خودش، از دِماغ و حافظه دارد؛ با اطلاعاتی که از ژنهایِ در طولِ تاریخش دارد دو سنخ است: دو حوزه است. خیلی چیزها را ما داریم، برایمان هم واضح است، اما از دِماغ نداریم.

١. اطّلاعات دِماغی

دِماغ یعنی چه؟ یعنی آن چیزی که الآن در شبکههای حافظه و سلّول و نورونهایِ عصبیِ مغزی ما باشد[1].نوزاد از وقتی که سلولهای بنیادین رشد پیدا کردند و بدن پیدا شد[2] و به دنیا آمد و با نور و این ها سروکار پیدا کرد، سلولهای مغزیش با این عالم تماس دارد.

٢. اطّلاعات ژنتیک

آن اطلاعاتی که در دی اِن اِی(DNA)[3] آن هاست که ژنتیکشان[4] است خیلی تفاوت دارد با اطلاعاتی که در نورونهای مغزی آن ها و حافظهی آن هاست. نورونهای عصبی هم DNA دارند در دلِ هر سلّولی ولو غیر نورون حتی ناخنِ بچه، دی ان ای(DNA) وجود دارد.

اطّلاعات عقل

تمام اطلاعاتی که مغز در محدوده محیطیاش است که آن سلولهای حافظه او هستند، با تمام اطلاعاتی که از تاریخ در دی اِن اِی تاریخ با خودش آورده است، همه این ها را در نظر بگیرید. این ها ذرّات مادیاند که نظم خاصّ اطلاعاتی دارند. عقل دارد از همه این ها استفاده میکند؛ اما خود این اطلاعات و ذرّاتِ مادی، عقل نیستند؛ پردازشگر نیستند.

پردازش عقل: غیر مادّی

اساساً پردازش در مغز ،به صورت مادّی سر نمیرسد. حافظه مغز، بدون پردازش نمیتواند کاری انجام بدهد. تا شما پردازشگر نداشته باشید با حافظه ذخیره شده به عنوان ذخیره اطلاعات، نمیتوانید هیچ کاری انجام بدهید.

هوش مصنوعی و ادراکات

یعنی اگر شما هزار بار رَم یک کامپیوتر، هاردش و تمام ذرّاتش را تحلیل کنید تا یک عقلی نباشد که به منزله نرم افزاری باشد که این پای سختافزاری را مدیریت کند، سر نمیرسد.

کامپیوترهای زیستی

حتّی کامپیوترهای کوانتومی که بالاتر از زیستی است. کامپیوترهای زیستی[5] میخواهند از شبه دی اِن اِی برای حافظهاش استفاده کنند.

کامپیوترهای کوانتومی

کامپیوترهای کوانتومی[6] عجیبتر است ؛ از ذرات ماده استفاده میکنند برای ذخیرهسازی اطلاعات.

درست است که بشر، دِماغ دارد؛ اطلاعات ژنتیکی تاریخی هم دارد، اما واقعاً کلّ بشر با یک منفصل، معقول منفصل، مثال منفصل، محسوس منفصل، با این ها دمساز است که میرود از آن ها تکامل علمی پیدا میکند، بیرونِ خودش را درک میکند. نه اینکه او به شکلی طراحی شده باشد که مجبور باشد این طور فکر کند.

[1] مغز مهمترین و اصلی ترین بخش دستگاه عصبی مرکزی است و در تمامی جانداران از سلول عصبی یا نورون و سلول گلیال یا نوروگلیا تشکیل شدهاست. سلولهای گلیال انواع گوناگونی داشته و انجام تعدادی از عملکردهای مهم ازجمله پشتیبانی ساختاری، پشتیبانی متابولیک یا سوختوساز یاخته، عایق و همچنین هدایت را به عهده دارند. نورونها، اما، معمولاً مهمترین یاختههای در مغز انگاشته میشوند. ویژگی یگانه یاختهٔ عصبی در ایجاد و انتقال پیام به دورترین نقاط بدن است

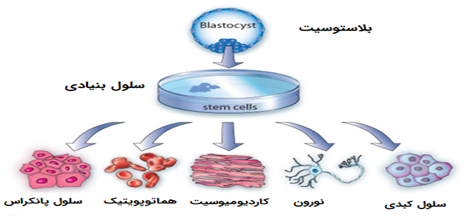

[2] میدانیم که همه سلولهای بدن، دارای ژنوم واحد و کاملا یکسانی هستنند. اما طی فرایند تمایز، هر سلول، به صورت هدفمند، گروه خاصی از ژنها را خاموش و گروه دیگر را روشن میکند و با یک برنامه هماهنگ با سایر سلولها، فعالیتهای خود را به صورت تخصصی انجام میدهد، اما گروهی از سلولها که سلولهای بنیادی نام دارند، نقش و فعالیت ویژهای در بدن ندارند و میتوانند به هر نوع سلول تخصصی که بدن به آن نیاز دارد، تبدیل شوند.در واقع سلولهای بنیادی سلولهای تمایز نیافتهای هستند که میتوانند با توجه به نیاز بدن به سلولهای تخصصی تبدیل شوند.

به طور خلاصه سلولهای بنیادی را میتوان به شکل زیر توصیف کرد:

بدن انسان از انواع متفاوتی از سلولها ساخته شده است. بسیاری از سلولها تخصصی هستند و عملکردهای ویژهای را انجام میدهند، مانند گلبولهای قرمز که اکسیژن را در جریان گردش خون به سراسر بدن منتقل کرده و دی اکسید کربن از سلولها دریافت میکنند. این در حالی است که به عنوان مثال، گلبولهای قرمز قادر به تقسیم نیستند.

سلولهای بنیادی همزمان با رشد ارگانیسم سلولهای جدیدی را برای بدن فراهم میکنند و آنها را جایگزین سلولهای تخصص یافته آسیب دیده یا از دست رفته میکنند. سلولهای بنیادی دو ویژگی منحصر به فرد دارند که آنها قادر میسازد تا این کار را انجام دهند:

این سلولها توانایی تقسیمهای متوالی را برای تولید سلولهای جدید دارند.

همزمان که این سلولها تقسیم میشوند، میتوانند به انواع سلولهای مختلف و تخصصی تمایز پیدا کنند.

به طور کلی مطالعات سلولهای بنیادی، زمینهای امید بخش برای درمان بسیاری از بیماریهایی است که در حال حاضر هیچ گونه روش درمانی برای آنها وجود ندارد.

سلولهای بنیادی از دو منبع اصلی حاصل میشوند:

بافتهای بالغ بدن

بافتها و سلولهای جنینی...

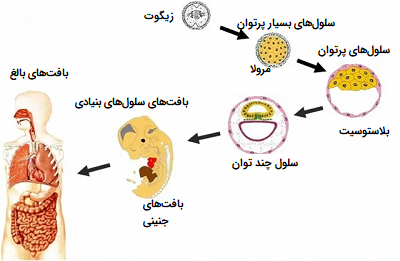

سلولهای بنیادی جنینی (Embryonic Stem Cells)

از همان مراحل اولیه بارداری، پس از این که اسپرم، تخمک را باور کرد، جنین تشکیل میشود. حدود ۳ تا ۵ روز پس از بارور شدن تخمک، جنین به صورت بلاستوسیست یا توپی از سلولها تشکیل میشود. این سلولها میتوانند به تمام ردههای سلولی تبدیل شوند.

بلاستوسیستها حاوی سلولهای بنیادی هستند که پس از چند روز در رحم لانه گزینی میکنند و در واقع به دیواره رحم متصل میشوند. سلولهای بنیادی جنینی از یک بلاستوسیست که سن آن ۴ تا ۵ روز است، به وجود میآیند.

هنگامی که دانشمندان سلولهای بنیادی را از جنین میگیرند، آنها معمولاً جنینهای اضافی هستند که از لقاح آزمایشگاهی یا مصنوعی (IVF) حاصل میشوند.

در کلینیکهای IVF، پزشکان چندین سلول تخمک را در یک لوله آزمایش بارور میکنند تا از زنده ماندن حداقل یکی از آنها اطمینان حاصل کنند. سپس برای شروع بارداری تعداد محدودی از تخمکهای بارور درون رحم جایگزین میشوند.

هنگامی که اسپرم تخمک را بارور میکند، این سلولها برای تشکیل یک سلول واحد به نام زیگوت یا تخم با یکدیگر ترکیب میشوند. سپس این زیگوت تک سلولی شروع به تقسیم میکند و سلولهای 2، 4، 8، 16 و ... را تشکیل میدهد در این محل جنین به وجود میآید.

در گام بعدی و قبل از کاشت جنین در رحم، این توده سلولی یا بلاستوسیت در حدود 150 تا 200 سلول دارد. بلاستوسیست از دو بخش تشکیل شده است:

یک توده سلولی بیرونی که بخشی از جفت میشود.

توده سلولی درونی که بدن انسان را میسازد.

توده سلول داخلی جایی است که سلولهای بنیادی جنینی یافت میشوند. دانشمندان سلولهای این بخش را «سلولهای بسیار پرتوان» (Totipotent Cells) مینامند. اصطلاح پرتوان به این واقعیت اشاره دارد که آنها پتانسیل بالایی در تبدیل شدن به انواع سلولهای بدن دارند.

با تحریک مناسب، این سلولها میتوانند به سلولهای خونی، سلولهای پوستی و سایر سلولهای دیگر که بدن نیاز دارند، تبدیل شوند. در اوایل بارداری، مرحله بلاستوسیست حدود 5 روز قبل از کاشت جنین در رحم ادامه مییابد. در این مرحله سلولهای بنیادی شروع به تمایز میکنند. سلولهای بنیادی جنین میتوانند نسبت به سلولهای بنیادی بالغ به سلولهای بیشتری متمایز شوند.

به طور خلاصه عملکرد سلولهای بنیادی جنین را میتوان به صورت زیر بیان کرد:

سلولهای جنینی بنیادی میتوانند سلولهای جدید جنین را برای رشد و تکامل به یک نوزاد کامل در خود ذخیره کنند.

این گروه از سلولها به عنوان سلولهای پرتوان شناخته میشوند که میتوانند به هر نوع از سلولهای یک ارگانیسم تبدیل شوند.(سایت فرادرس،مقاله سلول بنیادی چیست؟)

[3] مولکول DNA ( دی ان ای) یا «دئوکسیریبونوکلئیک اسید» (Deoxyribo Nucleic Acid) نام شیمیایی ترکیبی است که تمام اطلاعات ژنتیکی و ویژگیهای وراثتی موجودات زنده را در بر دارد. دی ان ای تمام کدها و اطلاعات ژنتیکی جانوران، گیاهان و حتی ویروسها را حمل میکند که این اطلاعات برای رشد، تکامل، بقا، تولید مثل و سایر عملکردهای موجودات، حیاتی است. محل قرارگیری DNA سلولهای جانوران مختلف، هسته سلول است (سایت فرادرس،مقاله مولکول DNA،از صفر تا صد)

[4] ژنوم دستورالعملهای ارثی برای ساخت، پیشبرد و نگهداری یک موجود زنده را داراست. کلمهٔ ژنوم از دو کلمهٔ ژن (gen) و پسوند (ome-) ساخته شدهاست. بدن انسان بهطور نسبی از پنجاه تا صد میلیارد سلول تشکیل شده که در هر سلول تمام دستورالعملهای کدگذاریشدهٔ لازم برای هدایت تمامی فعالیتهای یاخته و ساخت پروتئینهای لازم، موجود است. به هر گروه کامل از این دستورالعملهای ما ژنوم گفته میشود. میتوان ژنوم انسان را که در DNA ذخیره شدهاست با یک کتابخانه به صورت زیر مقایسه کرد:

کتابخانه شامل ۴۶ کتاب (کروموزوم) است

کتابها بین ۴۰۰ تا ۳۳۴۰ صفحه (ژن) دارند

هر کتاب دارای بین ۴۸ تا ۲۵۰ میلیون حرف (نوکلئوتید) کوچک است

یک کپی از کتابخانه (تمام ۴۶ کتاب) در تقریباً همهٔ سلولهای بدن ما قرار دارد(سایت ویکی پدیا)

[5] زیسترایانه (به انگلیسی: Biological Computing) دانشی است که در آن از ساختارهای مولکولی موجودات زنده (مانند دیانای و پروتئین) برای اعمال رایانش مانند ذخیره سازی، بازیابی و پردازش استفاده میشود. به دلیل امکان استفاده از آنها در انجام محاسبات موازی و حجیم، این فناوری جذابیت زیادی دارد. به یک واحد محاسبه گر زیست رایانه، رایانه ی زیستی گفته می شود.(سایت ویکی پدیا)

وقتی به منشا کلمه کامپیوتر نگاه میکنیم، متوجه میشویم که لوازم الکترونیکی ضروری نیستند. حتی اگر اکثریت ما با شنیدن این اصطلاح، دسکتاپ یا لپتاپ مدرن را تصور میکنیم. کامپیوتر وسیلهای است که قادر به مدیریت دادهها است. از این دیدگاه، مغز ما یکی از قویترین کامپیوترهای موجود است. پیشرفت قابل توجهی در جهت ایجاد کامپیوترهای بیولوژیکی به وجود آمده است. زمانی که آنها کاملا توسعه یابند، دنیای ما را تغییر خواهند داد. زیست رایانه، پیشرفتی در حوزهی نانو بیوتکنولوژی است که نقطهی اشتراکی بین علوم نانو و زیست را شامل میشود. با وجود این که هر سلول ساختاری مشابه یک رایانه دارد، محققان متوجه شدهاند که رفتار سلولهای موجودات زنده با رایانههای دیجیتال و پایگاه دادههایی که برای آنها تعریف شدهاند، تفاوتهای زیادی دارد. کامپیوتر زیستی یا زیست رایانه یک نوع کامپیوتر است که براساس فرآیندها و سیستمهای زیستی ساخته شده است. این نوع کامپیوترها از اجزای بیولوژیکی مانند: سلولها، پروتئینها و فرآیندهای بیوشیمیایی برای انجام محاسبات استفاده میکنند. زیست رایانهها معمولا از توانایی سلولها برای پردازش و انتقال اطلاعات بهره میبرند. ساختارهای زیستی مانند: DNA، آنزیمها و پروتئینها برای ذخیره دادهها و انجام عملیات محاسباتی استفاده میشوند. از طریق این مولکولها و فرآیندهای زیستی، زیست رایانهها قادر به انجام محاسبات پیچیده و حل مسائل مختلف میباشند.(سایت رهاکو، مقاله کامپیوتر زیستی: رویکردی نوین در ترکیب علوم زیستی و علوم کامپیوتر)

تلاش برای شبیه کردن کامپیوترها به مغز انسان پدیدهی جدیدی نیست. بااینحال گروهی از پژوهشگرهای دانشگاه جانز هاپکینز بر این باورند که میتوان با نورونهای واقعی به مزایایی در این زمینه رسید، گرچه موانع زیادی بر سر این راه وجود دارند.

بهگزارش ارزتکنیکا، گروهی از پژوهشگرها دستورالعملی از پیشنیازهای ساخت کامپیوترهایی زیستی را تهیه کردهاند که با سلولهای مغز انسان تقویت میشوند. به گفتهی یکی از پژوهشگرها، «هوش ارگانوئیدی» مزایایی شفافی نسبت به کامپیوترهای فعلی خواهد داشت. توماس هارتونگ، پژوهشگر بخش مهندسی و سلامت محیط دانشگاه جانز هاپکینز و یکی از مؤلفان مقالهی جدید میگوید: «همیشه برای ساخت کامپیوترهایی مشابه مغز انسان تلاش کردیم، بااینحال حداقل از دیدگاه تئوری مغز انسان بیهمتا است.»

موجود زنده

ارگانوئیدها بخشهای کوچکی از بافت هستند که در آزمایشگاه برای شبیهسازی اندامهای کامل پرورش مییابند. این انداموارههای کوچک دارای انواع مشخصی از سلولهای اندام و برخی ساختارهای داخلی هستند. پژوهشگرها با ارگانوئیدها میتوانند بدون نیاز به آزمایش انسانی یا جانوری، پژوهشهای خود را انجام دهند.

هارتونگ و همکاران او در حال کار با ارگانوئیدهای رشدیافته از سلولهای مغز انسان هستند. هارتونگ از سال ۲۰۱۲ پرورش ارگانوئیدها را از نمونههای پوست انسان شروع کرد که در یک وضعیت مشابه با سلولهای بنیادی تنظیم شده بودند. ارگانوئیدها کوچک و هماندازه با یک نقطهی ایجادشده با خودکار هستند، اما تعداد زیادی نورون (تقریباً ۵۰ هزار) و تعداد متنوعی از ساختارهای دیگر را دارند که امکان یادگیری و بهخاطرسپاری را به آنها میدهند.

به گفتهی هارتونگ، از این سلولها میتوان برای ساخت کامپیوترهایی با مزایای مختلف استفاده کرد. برای مثال چنین دستگاههایی میتوانند انرژی کمتری را نسبت به کامپیوترها و ابرکامپیوترهای رایج مصرف کنند. سرعت یادگیری مغز انسان بیشتر از کامپیوتر است و انرژی کمتری را مصرف میکند. برای مثال الگوریتم بازی آلفاگو بر اساس دادههای ۱۶۰ هزار بازی آماتور Go آموزش دیده بود. زمان قابل توجهی طول میکشد تا انسان بتواند این بازیها را اجرا کند با اینحال انسان هنوز هم عملکرد قابل ستایشی در بازی Go دارد. علاوه بر این مغز انسان در ذخیرهسازی دادهها بسیار خوب عمل میکند و بر اساس تخمینها میتواند تا ۲٫۵ میلیون گیگابایت داده را ذخیره کند.

کامپیوترهای ارگانوئیدی از نظر تئوری فضای کمتری را مصرف میکنند. این کامپیوترها در آینده ساختاری سه بعدی خواهند داشت به این صورت که تراکم سلولی آنها میتواند به شکل قابل توجهی افزایش پیدا کند و اتصالهای بیشتری بین نورونها شکل بگیرد. در نهایت با اینکه کامپیوترهای غیر انسانی از نظر پردازش مقدار زیاد دادهها بهتر عمل میکنند، باز هم مغز انسان در تصمیمگیری منطقی مثل شناسایی سریع یک حیوان عملکرد بهتری دارد.

سوکپال سینگ گیل، استادیار مهندسی الکترونیک و علوم کامپیوتر دانشگاه کویین مری لندن به طور مشابهی پتانسیل این نوع رایانش را ارزیابی میکند. او مصرف انرژی را محدودیت بزرگی برای رایانش، هوش مصنوعی و یادگیری ماشین میداند. از طرفی سلولهای مغز انسان چنین وظایفی را با سهولت یکپارچهسازی میکنند و پیشنیازهای انرژی کمتری دارند بهطوریکه تنها به یک محلول مغذی کوچک برای عملکرد صحیح نیاز دارند.

پیش از تبدیل شدن رؤیای کامپیوترهای زیستی به واقعیت، راه زیادی در پیش داریم. یکی از مشکلات مهم، اندازه است. ارگانوئیدها باید از ۵۰ هزار سلول به ۱۰ میلیون سلول برسند؛ اما بهسختی میتوان این تعداد سلول را در فضایی بزرگتر از نیم میلیمتر حفظ کرد زیرا اکسیژن و مواد غذایی نمیتواند بهراحتی به مرکز آنها برسد. یکی از راهحلهای این مشکل میتواند تزریق یا کانالبندی مایعات به داخل ارگانوئید باشد.

پژوهشگرها همچنین باید راههایی را برای برقراری ارتباط با ارگانوئیدها به منظور تبادل اطلاعات به روش کامپیوترها پیدا کنند. به همین دلیل بهبود حافظهی آنها امری حیاتی است. ارگانوئیدهای مغز در حال حاضر صرفاً میتوانند خاطرات کوتاهمدت را حفظ کنند. برای مثال میتوانید آنها را برای بازی پونگ آموزش دهید اما ممکن است روز بعد همه چیز را فراموش کنند. دلیل این مسئله میتواند این باشد که ارگانوئیدها فاقد سلولهای میکروگلیکا هستند. این سلولها نوعی سلول ایمنی هستند که در مغز ظاهر میشوند و عمل هرس سیناپسی یا ریشهکن کردن سیناپسهای زائد را انجام میدهند و به این ترتیب مغز میتواند به عملکرد عادی خود ادامه دهد.

همچنین پرسشهای اخلاقی دربارهی ساخت و پرورش سلولهای مغز و زنده بودن یا نبودن ارگانوئیدها وجود دارد. آیا ممکن است نوعی آگاهی در آنها به وجود بیاید یا درد را تجربه کنند؟ هارتونگ و تیم او در همکاری خود با متخصصین اخلاق زیستی در تلاش هستند همهچیز را بهگونهای ارزیابی کنند که ضرر اخلاقی نداشته باشد.(سایت زومیت، مقاله آیا آینده متعلق به کامپیوترهای زیستی خواهد بود؟)

[6] رایانهٔ کوانتومی (به انگلیسی: Quantum computer) ماشینی است که از پدیدهها و قوانین مکانیک کوانتوم مانند برهم نهی (Superposition) و درهم تنیدگی (Entanglement) برای رایانش استفاده میکند. رایانههای کوانتومی با رایانههای فعلی که با ترانزیستورها کار میکنند تفاوت اساسی دارند.(سایت ویکی پدیا)

ما قبل از اینکه به سراغ نحوه کار کامپیوترهای کوانتومی برویم لازم است نگاهی به کامپیوترهای معمولی و نحوهی کار آنها بیندازیم. همهی ما میدانیم که پایه و اساس کار کامپیوترهای امروزی بیتهای منطقی هستند، یعنی ۰ و ۱ که از کنار هم قرار گرفتن آنها دستورات مختلف رایانهای پدید آمده و پردازنده میتواند روی آنها محاسبات مختلفی انجام دهد. بیتها معمولا به کمک میزان ولتاژ در مدارات مختلف نشان داده میشوند، به عنوان مثال ولتاژ ۰ نمایانگر بیت ۰ و ولتاژ ۵ نمایانگر بیت ۱ است (میزان ولتاژها فرضی بوده و میتواند در هر سختافزار متفاوت باشد. ) ۲ بایت مختلف را در نظر بگیرید (هر ۸ بیت ۱ بایت را تشکیل میدهد) مثلاً (۱۰۱۰۱۱۰۰) نمایندهی عدد ۱۷۲ و (۱۱۱۰۱۱۰۰) نمایندهی عدد ۲۳۶ میباشد. هرکدام از این اعداد با توجه به وضعیت سیستم میتوانند به شکل متفاوتی تفسیر شوند، مثلا یک کارکتر در نرمافزار ورد، یک عدد در ماشین حساب، یک دستورالعمل در پردازنده، بخشی از یک موسیقی یا تصویر و…نکتهی مهم در این بخش این است که تنها تغییر یکی از این بیتها کافیست تا عدد تشکیل شده کاملا تغییر کند و در نتیجه مقدار نهایی این مجموعهی بیت نیز متفاوت شود. تغییر هر کدام از این بیتها باعث تغییر سرنوشت کل مجموعه میشود.

در کامپیوترهای معمولی هر بیت میتواند در لحظه تنها یک مقدار مشخص داشته باشد، یعنی هر بیت در لحظه میتواند ۰ باشد و یا ۱ ( تنها یکی از این مقادیر)

وجه تمایز کامپیوترهای کوانتومی و کامپیوترهای معمولی دقیقا در همینجاست، شاید تعجبآور باشد، اما باید بدانید کامپیوترهای کوانتومی میتوانند در هر لحظه انواع حالات را داشته باشند، یعنی بیتهای آنها هم برابر با ۱ است و هم برابر با ۰ که آنرا Qubit مینامند.(سایت همیار آی تی،مقاله آشنایی با کامپیوتر های کوانتومی و عملکرد حیرت انگیز آن ها)

در این مقاله قصد داریم تا شما را با یکی از شگفتانگیزترین ساختههای قرن 21، یعنی کامپیوتر کوانتومی آشنا کنیم. امروزه پردازندههای مورد استفاده در تلفنهای همراه به ساختاری ۷ نانومتری رسیده و انتظار میرود تا سال 2021 پردازندههایی با لیتوگرافی 5 نانومتری نیز روانه بازار شوند. بدون اغراق این پردازندههای کوچک، بیش از چندین برابر پردازندههای سطح بالا دسکتاپ که در دهه 2000 میلادی روانه بازار شدند، قویتر هستند. این امر نه تنها برای پردازندههای موبایل بلکه برای پردازندههای دسکتاپ و سرور که با لیتوگرافی 10 و ۷ نانومتری روانه بازار شدند نیز صادق است. با وجود این پیشرفت شگفتانگیز در کارایی و سرعت پردازندههای محاسباتی، هنوز مسائل پیچیدهای وجود دارند که حل آنها از عهده هیچ یک از سوپر کامپیوترهای موجود بر نمیآید. شاید. جدا از وجود مسائل پیچیده، یک مشکل اساسیتر در روند توسعه و ساخت تراشهها، کوچک شدن ابعاد ترانزیستورها است. امروزه شرکتهایی بزرگی چون AMD و اپل پس از تقلای بسیار به تکنولوژی ساخت تراشههای ۷ نانومتری دست پیدا کردهاند. در ساختارهای زیر 10 نانومتر، ابعاد ترانزیستورها به ابعاد اتمی نزدیک شده که در این صورت قوانین فیزیک کوانتومی نمود بیشتری پیدا کرده و قواعد بازی را عوض میکنند. به طور مثال یک الکترون میتواند از یک ترانزیستور به ترانزیستور دیگر تونلزنی انجام دهد، که این پدیده برای یک تراشه محاسباتی، امر مطلوبی نیست. در طول تاریخ، عموماً شاهد تبدیل چالشها به فرصتها، توسط فیزیکدانان بودهایم. شما چه راه حلی را برای مشکل فوق پیشنهاد میکنید؟ آیا به نظرتان دنیای پردازندهها به انتهای خود نزدیک شده و دیگر پیشرفت قابل ملاحظهای را به خود نمیبینند؟ بعید است! علم و تکنولوژی هیچگاه متوقف و یا به عقب برنمیگردند. حال که به دنیای فیزیک کوانتومی وارد شدهایم، نظرتان چیست که محاسبات را از دنیای کلاسیک به دنیای کوانتوم بیاوریم؟ در ادامه این مطلب همراه ما باشید تا با زبانی ساده و به دور از روابط پیچیده، به بحث محاسبات و کامپیوتر کوانتومی بپردازیم.

محاسبات رایج (Conventional Computing)

آیا تا به حال فکر کردهاید اموری سادهای که در طول روز توسط کامپیوتر یا موبایل خود انجام میدهید، چگونه توسط پردازنده (CPU) دستگاه شما انجام میگیرد؟

کامپیوترهای متعارف میتوانند اعداد (۰ و ۱) را در حافظه خود ذخیره و روی آنها عملیات ساده ریاضی (پردازش) را انجام دهند. عمل ذخیرهسازی و پردازش توسط سوییچهایی به نام ترانزیستور انجام میگیرد. ترانزیستورها را میتوانید نسخهای میکروسکوپی از سوییچهایی که روی دیوار جهت خاموش و روشن شدن چراغها استفاده میشود، در نظر بگیرید. در واقع یک ترانزیستور میتواند روشن و یا خاموش باشد. درست همانطور که نور میتواند روشن و یا خاموش شود. از ترانزیستور روشن میتوانیم برای ذخیره یک (۱) و از خاموش بودن آن برای ذخیره صفر (۰) استفاده کنیم.

رشتههایی طولانی از این صفر و یکها میتوانند برای برای ذخیره هر عدد، نماد و حروفی استفاده شوند. به طور مثال در قواعد کد «اسکی» (ASCII) رشته 1000001 برای نمایش A و رشته 01100001 برای نمایش a به کار میرود. (برای تبدیل کد اسکی از این لینک استفاده کنید). هر کدام از این ۰ و ۱ها یک رقم باینری یا بیت نامیده میشوند که با رشتهای ۸ بیتی میتوانید ۲۵۵ کاراکتر مختلف مثل A-Z، a-z و 0-9 را ذخیره کنید. یادآور میشویم که هر 8 بیت معادل ۱ بایت در نظر گرفته میشود.

کامپیوترها با استفاده از مدارهای (دروازه - گیت) منطقی (Logic Gates) که از تعدادی ترانزیستور ساخته شدهاند، محاسبات و پردازش را بر روی بیتها انجام میدهند. یک گیت منطقی حالت یک بیت را سنجیده و در حافظهای موقت موسوم به رجیستری ذخیره میکند. سپس آنها را به حالت جدیدی تبدیل میکند. در واقع معادل عمل جمع، تفریق یا ضرب که ما در ذهن خود انجام میدهیم. یک الگوریتم در سطح پایین و به صورت فیزیکی، در واقع متشکل از چندین گیت منطقی است که کنار یکدیگر تشکیل یک مدار الکترونیکی را دادهاند. این مدار محاسبه یا عمل خاصی را انجام میدهد.

همانطور که در مقدمه مقاله اشاره کردیم، روند کوچکسازی ابعاد ترانزیستورها با مشکل مواجه بوده و در لیتوگرافیهای زیر 10 نانومتر به کندی پیش میرود. تا قبل از اختراع ترانزیستور در سال 1947،

سوییچهایی که عمل ترانزیستور را انجام میدادند، لامپهایی خلأ بودند که اندازه بزرگی داشتند. امروزه روی یک تراشه پیشرفته به اندازه ناخن دست، میلیاردها ترانزیستور وجود دارد. در دهه 1960، گوردن مور یکی از بنیانگذران شرکت بزرگ «اینتل» (Intel) قانونی تجربی را که به «قانون مور» (Moore's law) معروف است بیان کرد. این قانون پیشبینی میکند که به طور متوسط هر ۱۸ ماه تعداد ترانزیستورها بر روی یک تراشه با مساحت ثابت، دو برابر میشود.

مطابق با پیشبینی قانون مور، از دهه 1960 تا کنون با افزایش تعداد ترازیستورها و در نتیجه افزایش حافظه و سرعت کامپیوترها، برخی از مسائل پیچیده حل شده و از تعداد آنها کم شده است. اما همچنان مسائلی وجود دارند که حتی سوپرکامپیوترهایی که در چند سال اخیر به جهان عرضه شدند، قدرت و توانایی حل آنها را ندارند. جدا از مطلب فوق، در چند سال اخیر فرآیند ساخت ترانزیستورها و لیتوگرافیهای کمتر از 10 نانومتر با مشکلاتی مواجه بوده و به کندی پیش میرود. در واقع به نظر میرسد که قانون مور به پایان عمر خود نزدیک است. جدا از راهکارهای کلاسیکی برای رفع مشکلات، میتوانیم رویکردهای فیزیک کوانتومی را بررسی و علم محاسبات را به دنیای کوانتومی وارد کنیم.

نظریه و فیزیک کوانتوم قوانین حاکم بر دنیای میکروسکوپی، اتمها و ذرات زیر اتمی را تشریح میکند. همانطور که احتمالاً میدانید، در مقیاسهای اتمی، قوانین فیزیک کلاسیک دیگر کارایی نداشته و نیاز است تا قوانین جدیدی را به کار بریم.

در کتابهای اپتیک، نور را موجودی دوگانه (موج و ذره) تعریف میکنند. در واقع نور بخشی از طیف امواج الکترومغناطیسی است که در عین حال یک ذره (فوتون) هم میتواند باشد! شاید بپرسید چگونه یک چیز واحد میتواند دو موجودیت داشته باشد؟! بله، در دنیای کوانتوم نظیر چنین مطالبی امری عادی است. به جز بحث دوگانگی موج - ذره نور، یکی دیگر از مثالهای معروف دنیای فیزیک کوانتوم، گربه شرودینگر است. این گربه که در جعبهای قرار دارد، در هر لحظه هم میتواند زنده باشد و هم مرده!

اجازه دهید نگاهی گذار به روند پیشرفت علوم کامپیوتر و محاسبات که باعث شدند امروزه کامپیوترهای کوانتومی به گزینهای جدی برای انجام محاسبات تبدیل شوند، داشته باشیم. آغاز این روند از دو فیزیکدان و محقق شرکت «آی بی اِم» (IBM) به نامهای «رالف لاندائور» (Rolf Landauer) و «کارلس بِنِت» (Charles H. Bennett.) بود. لاندائور در دهه 1960 مطرح کرد که اطلاعات ماهیتی فیزیکی دارند که با توجه به قوانین فیزیکی میتوانند تغییر کنند.

یکی از نتایج بسیار مهم از طرح لاندائور این است که کامپیوترها، به واسطه دستکاری و تغییر اطلاعات (بیتها) باعث به هدر رفتن انرژی میشوند. به همین دلیل است که قسمتهای پردازشی در یک کامپیوتر نظیر تراشه مرکزی (CPU) و تراشه گرافیکی (GPU) حتی اگر عملیات سنگینی انجام ندهند، انرژی بسیار زیادی مصرف کرده و گرم میشوند.

بِنِت در دهه 1970 در راستای طرح لاندائور، نشان داد که اگر کامپیوترها بتوانند عملیات پردازش را به طور برگشتپذیر انجام دهند، میتوان از اتلاف انرژی به حد زیادی جلوگیری کرد. منظور از پردازش یا محاسبات برگشتپذیر به طور خیلی ساده این است که با داشتن خروجی اطلاعات (بیتهای خروجی) بتوانیم به اطلاعات ورودی (بیتهای ورودی) پی ببریم. برای تحقق این امر باید دروازههای (گیت) منطقی ساخت که به طور برگشت پذیر کار میکنند. در فیزیک و محاسبات کلاسیک تنها گیت NOT برگشتپذیر است. برای آشنایی با یکی از مهمترین گیتهای برگشتپذیر پیشنهاد میکنیم به مقاله «گیت برگشت پذیر توفولی (CCNOT) -- به زبان ساده» رجوع کنید. پس انتظار میرود که کامپیوترهای کوانتومی با انجام محاسباتی برگشتپذیر، عملیات گسترده و سنگینی را بدون صرف انرژیهای بسیار زیاد انجام دهند. در مقام مقایسه خوب است بدانید که کامپیوتر کوانتومی D-Wave 2000Q ساخت شرکت کانادایی «دی وِیو» (D-Wave) تنها 25کیلووات انرژی مصرف میکند. در حالی که سوپرکامپیوتر Summit که از تراشههای شرکت «انویدیا» استفاده میکند توان مصرفی 13مگاوات را دارد!

ویژگیهای اصلی کامپیوترهای معمولی نظیر بیت، الگوریتم، گیتهای منطقی و ... به طور مشابه در کامپیوترهای کوانتومی نیز وجود دارند. اصلیترین جزء یک کامپیوتر کوانتومی، در واقع واحد پردازش اطلاعات، بیت کوانتومی یا کیوبیت است. عملکرد یک کیوبیت شاید کمی مبهم به نظر آید.همانطور که میدانید یک بیت کلاسیک در هر لحظه تنها میتواند یکی از دو مقدار ۰ و ۱ را داشته باشد؛ اما یک کیوبیت در هر لحظه هم میتواند ۰ باشد و هم ۱ یا حتی هر چیزی دیگری بین ۰ و ۱ ! در واقع یک کیوبیت در حالت «برهمنهی» (Superposition) از حالتهای پایه ۰ و ۱ است. برای مشخص شدن حالت کیوبیت باید آن را اندازهگیری کرد، در این صورت حالت برهمنهی فرو ریخته و کیوبیت با یک احتمالی در 0 و یا ۱ ظاهر میشود.از آنجایی که یک کیوبیت در هر لحظه میتواند مقادیر مختلفی را به طور همزمان در خود ذخیره کند (برهمنهی از حالتهای 0 و ۱)، میتوان نتیجه گرفت که یک کامپیوتر کوانتومی به هنگام پردازش کیوبیتها، میتواند اطلاعات را به صورت همزمان پردازش کند. در واقع بر خلاف کامپیوترهای معمولی که عمل پردازش و محاسبات را به طور «سری» (Serial) انجام میدهند، کامپویترهای کوانتومی میتواند محاسبات را به صورت «موازی» (Parallel) انجام دهند. این امر سرعت بسیار زیادی را در انجام محاسبات نسبت به یک کامپیوتر معمولی به ارمغان میآورد. میدانیم که بیتهای معمولی به وسیله گیتهای منطقی پردازش میشوند. در کامپیوترهای کوانتومی نیز، کیوبیتها توسط گیتهای کوانتومی پردازش میشوند. گیتهای کوانتومی در واقع عملگر یا اپراتورهای (Quantum Operators) تحول زمانی یکانی هستند که در مدت زمان مشخصی، یک نگاشت یک به یک را انجام داده و در یک حالت کوانتومی را به حالت دیگری تبدیل میکنند. از آنجایی که گیتهای کوانتومی، نگاشتی یک به یک را انجام میدهند، عملیات انجام شده توسط آنها برگشتپذیر است.(سایت فرادرس، مقاله کامپیوتر کوانتومی به زبان ساده)

بدون نظر